OGQ GYN Developers Day는 OGQ GYN의 모델 개발 과정 및 논문 등을 많은 기업분들께 발표하는 자리로, 매월 마지막 주 수요일에 진행되고 있습니다.

이번 컨퍼런스에선 Character Recognition, Person Detection, Fire Detection 각 모델의 개발 내용 및 성능, 샘플을 발표했습니다.

Contents

Conference 개요

•

일시 : 2022년 4월 27일 13:00 ~ 14:00

•

장소 : Zoom 미팅

•

참여기업 (가나다순)

◦

베스트디지탈 BEST DIGITAL

◦

셀링스시스템 Cellinx

◦

아이닉스 Eyenix

◦

원우이엔지 WONWOO

◦

웹게이트 WEBGATE

◦

트루엔 TRUEN

•

순서

1.

참여 업체 소개

2.

OGQ GYN 발표

•

사회자: OGQ GYN 우재현 연구원

•

발표자: OGQ GYN 오다연 연구원

3.

Q&A

1. Previous Presentation Summary

지난 컨퍼런스에서는 LP(License Plate) Detector를 주제로 진행했습니다.

#Model Performance(LP Detector)

#Samples

2. Character Recognition

Character Recognition Model의 성능 테이블과 지원 번호판, Sample 이미지입니다. 현재의 번호판 인식 시나리오는 LP Detector를 통해 번호판 영역을 탐지한 뒤 해당 영역에서 Character Recognition을 수행하는 방식입니다.

2-1. Model Performance

•

아래 테이블은 Character_Recognition의 정확도를 보여줍니다. 현재 서버 타입만 제공 중이며 EN675에서 동작 가능하도록 업데이트할 예정입니다. 정확도는 이미지 내 모든 글자를 순서대로 맞춘 경우를 1, 아닌 경우를 0으로 계산한 평균값을 의미합니다. 5,598장의 학습에 사용되지 않은 이미지에 대해 평가한 결과 99.20%의 정확도를 달성했습니다.

•

아래의 5가지 구조의 번호판을 지원하며 다양한 색상에서 robust하게 동작합니다. 현재 “서울”, “인천”, “경기”만 지원 중이며, 향후 데이터를 추가해 보완할 예정입니다.

2-2. Qualitative Result

전반적으로 잘못된 인식이 없었으나, 어둡고 노이즈가 많은 상황에서 잘못된 인식이 발생됩니다. 어두운 장소에서의 인식은 해결해야 할 문제입니다.

•

지명 미포함

•

지명 포함

•

주차장 환경 (노이즈, 어두운 조명)

3. Person Detection

Person Detection의 성능 결과 테이블과 Sample 이미지입니다.

3-1. Model Performance

•

EN675에서 동작하는 Eyenix 제공 모델 및 GY 모델과 서버에서 동작하는 GY 모델의 각 데이터 별 AP비교 테이블입니다.(단위: AP@0.50 높을 수록 좋음)

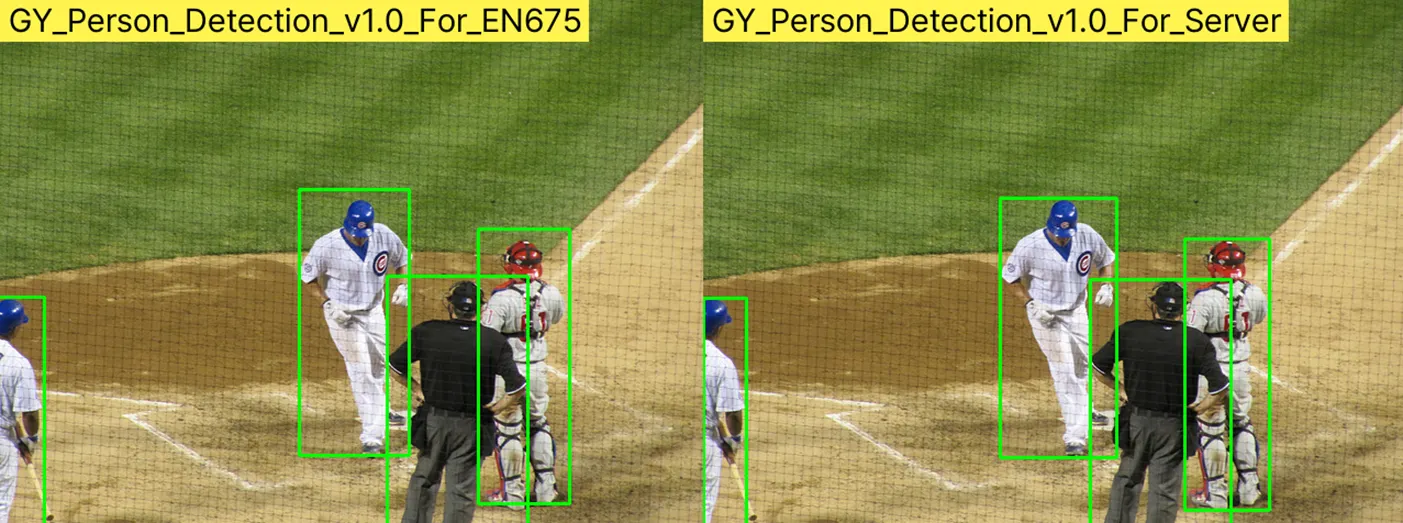

3-2. Qualitative Result

•

Sample01 - 객체 영역이 큰 경우

객체 영역이 큰 이미지에 대한 각 모델 별 output입니다. 객체가 큰 낮 시간대 이미지에서는 두 모델 모두 정상적으로 동작하는 것을 확인할 수 있습니다.

(left: EN675, right: Server)

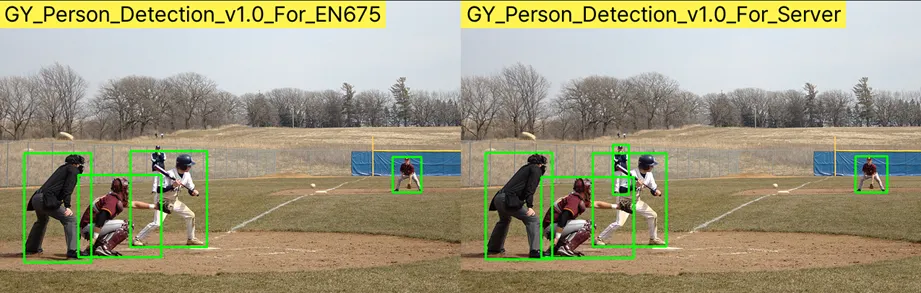

•

Sample02 - 객체 영역이 15% 미만으로 작은 경우

오른쪽의 이미지에서는 작은 사람도 검출해내지만, 왼쪽 이미지에서는 검출하지 못한 것을 확인할 수 있습니다. 이미지에서 객체 영역이 15% 미만으로 작은 경우 EN675 모델에서 탐지가 어렵습니다. 작은 객체도 검출 가능하도록 개선이 필요합니다.

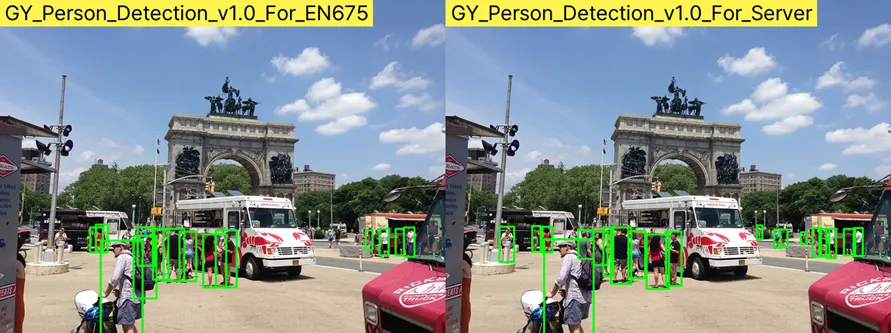

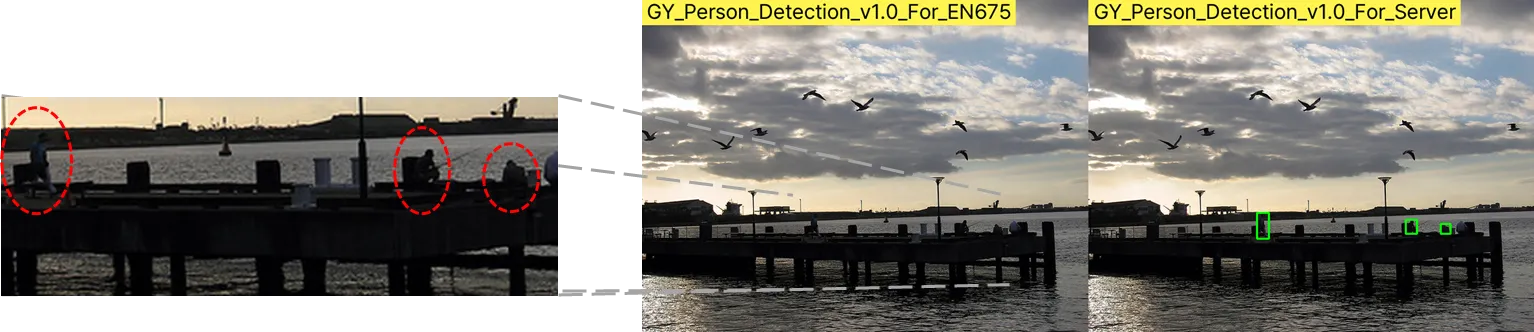

•

Sample03 - 객체가 많은 겨우 및 객체가 작고 어두운 경우

위와 마찬가지로 EN675의 경우 작은 객체는 인식이 어렵지만, 객체가 10개 이상으로 많은 상황에서도 정상적으로 감지를 수행합니다. 서버 타입에서는 객체가 작고 어두운 경우에도 올바르게 인식하는 것을 확인할 수 있습니다. EN675에서도 검출 가능하도록 노력할 것입니다.

4. Fire Detection

Fire Detection의 경우 EN675 포팅을 위한 컴파일이 진행 중이기에 성능 테이블이 존재하지 않습니다.

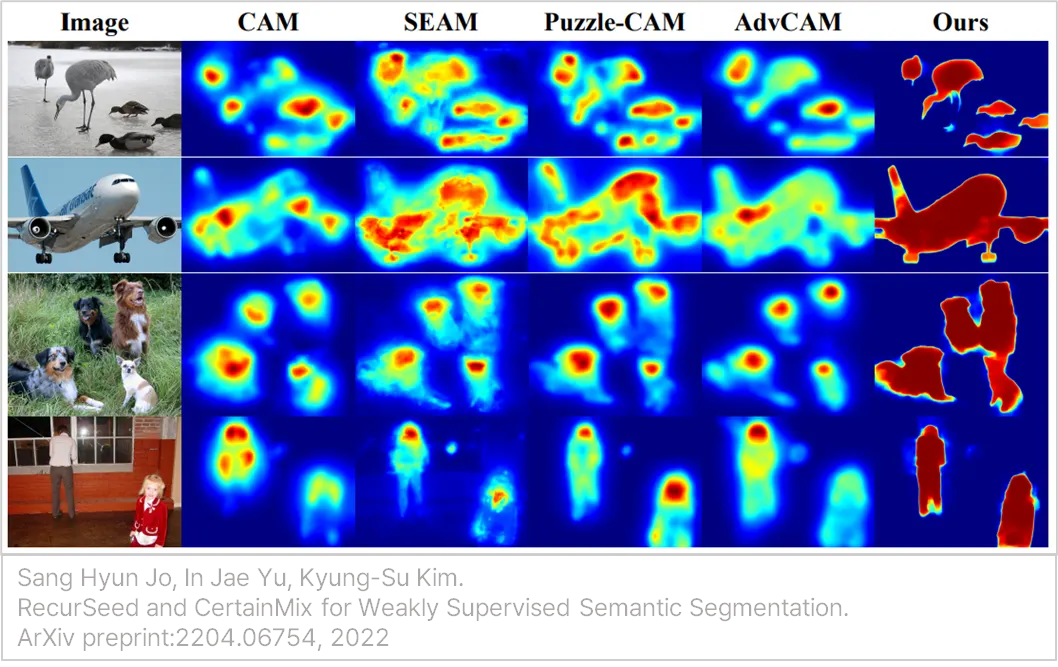

4-1. RSCM (RecurSeed and CertainMix)

•

RSCM은 tag를 기반으로 semantic segmentation mask를 생성하는 지와이네트웍스의 자체 기술입니다.

•

아래 이미지에서 가장 왼쪽 열은 input image이며 나머지 열은 각 접근법 별 모델의 output입니다. RSCM의 output은 명확한 경계를 가진 것을 확인할 수 있습니다.

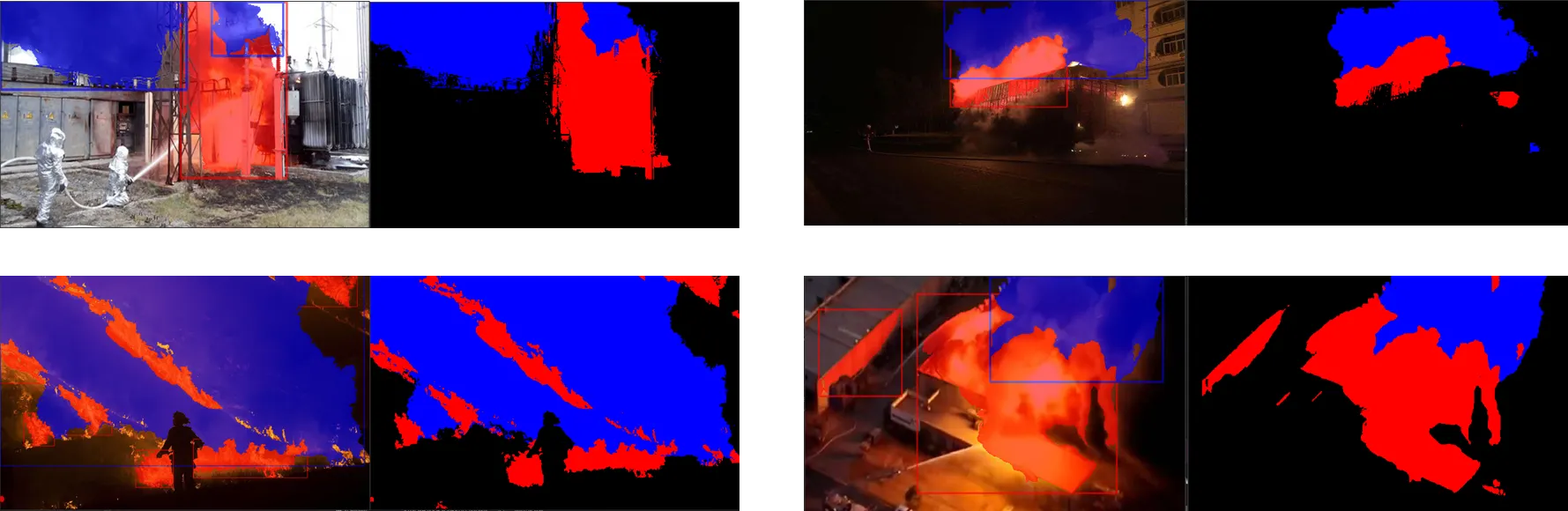

4-2. RSCM을 활용한 정답지 생성

•

지와이네트웍스가 보유 중인 화재 데이터셋은 tag 데이터만 존재하며 train set은 약 2.3만장입니다.

•

우리의 목표는 SSD 화재 모델 학습이지만, SSD는 Fully Supervised 방식으로 학습하기 때문에 보유한 데이터 만으로는 학습이 불가능했기에 RSCM을 활용했습니다.

•

아래 각 이미지의 오른쪽은 RSCM으로 생성한 semantic segmentation mask입니다. 이를 바탕으로 왼쪽의 이미지처럼 바운딩 박스를 생성해 데이터를 준비했습니다.

각 이미지의 left: right로 생성한 바운딩박스

각 이미지의 right: RSCM으로 생성한 Semantic Segmentation Mask

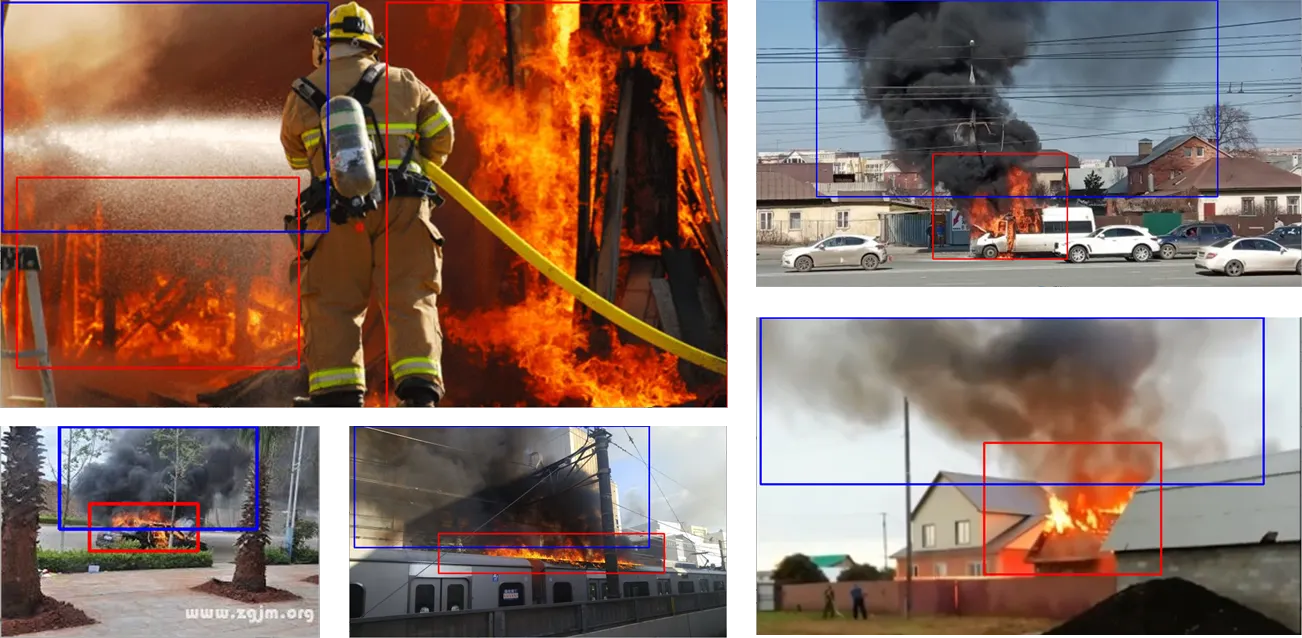

4-3. Qualitative Result

서버 타입 모델의 output 이미지입니다.

•

Sample01 - 화염만 포함된 이미지

•

Sample02 - 연기만 포함된 이미지

•

Sample03 - 화염과 연기 모두 포함된 이미지

List

Search

OGQ GYN의 기술블로그를 비상업적으로 사용 시 출처를 남겨주세요.

상업적 용도를 원하실 경우 문의 부탁드립니다.

E-mail. tech@gynetworks.com

.jpg)

-1.png&blockId=006c3d89-59c3-4ab4-bd0e-178e4957f2af)

-2.png&blockId=61585fc0-9805-4bca-bc77-81e3e3cb341d)

-3.png&blockId=9d5c794f-9f7c-4c8a-a19a-05442315da89)

-4.png&blockId=3055fd94-9691-415b-b0e7-1a67111abdaf)

-5.png&blockId=e0c84d7d-3ab1-4bb8-b2cc-606a1a51846e)

-6.png&blockId=64644c01-6e1f-4b1f-b6e1-9d6699057919)

-7.png&blockId=b44538f0-5920-4542-ba55-caa821e63a1b)

-8.png&blockId=787a2f3b-e275-42ce-a5e6-79b99e27a217)

-9.png&blockId=79094d6c-2439-4d8c-9faf-8ffe2d4190b6)

-10.png&blockId=eace6c6f-8b4b-45e6-9e9c-05c12a11cf37)